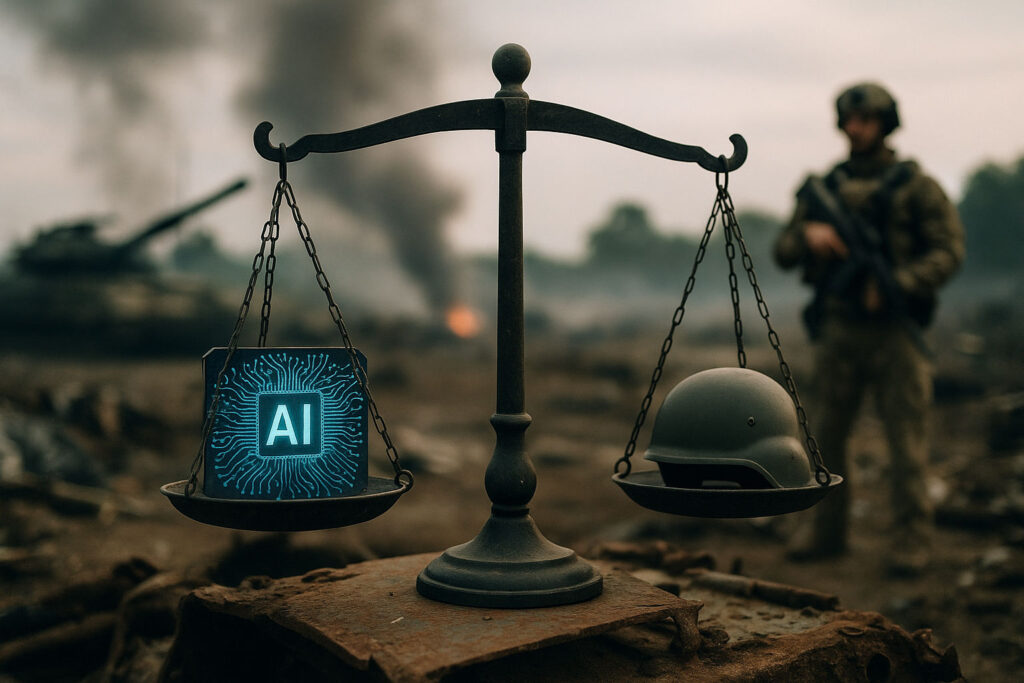

En un mundo donde la inteligencia artificial avanza a pasos agigantados, la utilización de estas tecnologías por parte del sector militar plantea interrogantes que van más allá de la eficiencia y la estrategia. La reciente declaración de Anthropic, una compañía de IA, sobre su negativa a permitir el uso irrestricto de su tecnología por el Departamento de Guerra de EE.UU. ilustra el creciente conflicto entre innovación y ética. Al rechazar la presión del Pentágono, Anthropic pone de relieve la necesidad de salvaguardas que protejan los valores democráticos en un ámbito donde la automatización puede desdibujar los límites de la moralidad.

El dilema de la defensa y la ética

En este contexto crítico, Anthropic se encuentra ante un dilema moral profundo. La creación de tecnologías de inteligencia artificial para el ámbito militar puede resultar atractiva por su capacidad de optimizar la defensa y proteger a la nación, sin embargo, también plantea un grave riesgo para la libertad y la democracia. Al ceder el juicio moral a sistemas algorítmicos, corremos el peligro de deshumanizar decisiones que deben considerar no solo datos, sino también el bienestar de las personas.

Imaginemos una situación en la que un algoritmo tiene que decidir entre atacar o retirarse en un conflicto. Un juicio tan complejo y cargado de matices no puede ser reemplazado por líneas de código. La responsabilidad ética implica reconocer que detrás de cada decisión hay vidas humanas, y que los algoritmos, por más avanzados que sean, carecen de la empatía y la comprensión del contexto que los seres humanos poseen. A medida que avanzamos hacia un futuro donde la inteligencia artificial juega un papel fundamental en cuestiones de seguridad, debemos preguntarnos: ¿estamos preparados para afrontar las implicaciones de liberar estas herramientas sin la guía de nuestra moralidad intacta?

Responsabilidad y control

La negativa de Anthropic a entregar su tecnología sin las garantías adecuadas representa un paso firme hacia la responsabilidad corporativa en el uso de la inteligencia artificial militar. En un contexto donde la automatización puede desencadenar decisiones letales, la empresa subraya la importancia de un control estricto sobre la IA en situaciones de conflicto. Este reto es más que técnico; se adentra en el ámbito humano y ético, donde cada decisión puede afectar vidas.

Las dinámicas de la guerra moderna están marcadas por la rapidez y la imprevisibilidad. Un ejemplo palpable es el uso de drones autónomos, que podrían actuar sin la intervención humana. Sin un marco que promueva la innovación con un compromiso hacia la protección de la vida, el riesgo no es solo una cuestión de estadísticas: se trata de la humanidad misma. La presión del avance tecnológico no debe llevar a cruzar líneas rojas que, una vez dibujadas, son difíciles de borrar. Establecer límites es esencial para preservar nuestro juicio ético en este nuevo escenario bélico.

Un futuro incierto

Con el auge de la IA militar, la línea entre defensa y agresión se vuelve cada vez más difusa. La posibilidad de usar tecnología para optimizar la estrategia en el campo de batalla puede sonar atractiva, pero lleva consigo un peso moral considerable. La responsabilidad de los líderes tecnológicos es monumental: están en una encrucijada donde su decisión puede determinar no solo el futuro de la guerra, sino también los valores éticos de nuestra sociedad.

Ejemplos recientes muestran que la presión del mercado y del Estado puede ser abrumadora. Sin embargo, algunos innovadores, como los de Anthropic, ofrecen una respuesta reflexiva a esta presión al negarse a adoptar prácticas que podrían comprometer vidas. Pero, ¿qué ocurrirá si otros eligen el camino más fácil, priorizando el beneficio económico sobre la responsabilidad?

Este entorno plantea interrogantes inquietantes sobre el papel de la tecnología en la humanidad. ¿Podrán estos líderes forjar un futuro donde la ética y la innovación vayan de la mano, o se verán arrastrados a un abismo de decisiones mecánicas y deshumanizadas? La historia está en sus manos, y el futuro es incierto.